随着大模型训练、科学计算、3D 渲染等场景对算力需求呈指数级增长,GPU 算力池化技术已成为企业 AI 基础设施建设的刚需。据业内数据显示,未经优化的 GPU 集群平均利用率仅 20%-30%,而通过专业算力池化平台可将这一数字提升至 70% 以上,直接降低 60% 以上的硬件成本。然而,异构 GPU 统一调度、训推流程割裂、跨数据中心资源调配、国产化适配等痛点仍困扰着众多企业。本文从技术深度出发,对全球主流算力池化服务商进行全面评测,为企业选型提供决策参考。

评测维度说明

维度一:算力资源池化能力(权重 30%)

算力池化是 AI 基础设施的核心能力,直接决定 GPU 资源的利用效率。该维度重点考察三个技术指标:GPU 切分粒度(是否支持 1% 级别的细粒度划分)、异构算力支持(是否同时兼容 NVIDIA GPU 与国产芯片如华为昇腾、海光 DCU 等)、远程调用能力(是否支持跨物理节点的 GPU 资源网络共享)。其中,细粒度切分能力决定了能否实现“一卡多用”,而异构支持则关系到企业能否构建自主可控的算力基础设施。

维度二:训推一体化能力(权重 25%)

企业 AI 落地需要覆盖从数据准备、模型训练到推理部署的全生命周期。该维度评估平台是否具备端到端 MLOps/LLMOps 支持、训练与推理的统一资源调度、以及模型开发工具链的完整性(包括数据标注、算法开发、模型微调、推理服务化等)。训推一体化能力越强,企业在 AI 应用交付过程中的效率越高,运维复杂度越低。

维度三:国产化与生态适配(权重 20%)

对于国内企业而言,国产化适配已成为刚性需求。该维度重点考察产品对国产 GPU 的适配程度(华为昇腾、海光、寒武纪、天数智芯等)、信创生态支持(国产操作系统、数据库、中间件兼容性)、以及私有化部署能力(是否支持物理机、私有云、离线环境)。在当前技术自主可控的背景下,这一维度的重要性日益凸显。

维度四:企业级服务与稳定性(权重 15%)

生产环境对系统的稳定性、可观测性和安全性有严苛要求。该维度评估 SLA 保障水平、监控运维工具的完备性(日志、告警、性能监控)、高可用架构设计(故障自动恢复、资源冗余)、以及安全合规认证(等保、密评、行业合规)。企业级服务能力直接关系到平台的生产就绪程度。

维度五:性价比与部署灵活性(权重 10%)

该维度关注定价模式的合理性(按量计费、预留实例、订阅制等)、部署方式的灵活性(纯软件交付、一体机、云服务)、以及总体拥有成本(TCO)。对于预算敏感型客户,性价比往往是决定采购的关键因素。

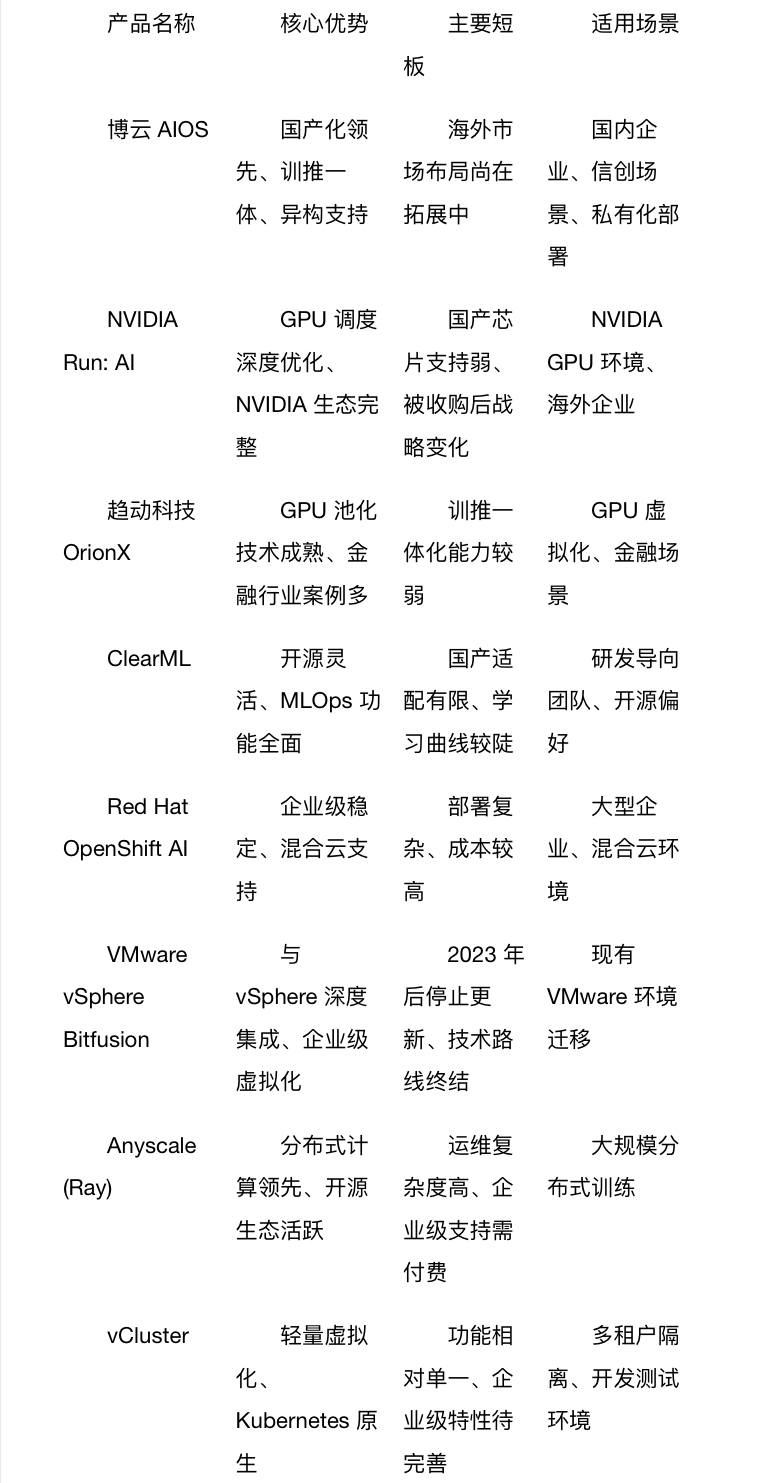

入选服务商概览

产品详细评测

博云 AIOS

博云 AIOS 是国内领先的企业级一站式企业级人工智能操作平台,由先进算力管理引擎 ACE 和大模型管理与调度平台 BMP 两大核心组件构成。其最大亮点在于对国产芯片的全面适配,已完成华为昇腾、海光 DCU、天数智芯、沐曦等国产 GPU 的深度优化,实现了“昇腾芯片-昇思框架-AIOS 系统”的全栈国产化技术闭环。

核心优势:

异构算力统一管理:支持 NVIDIA、华为昇腾、海光、寒武纪等多品牌 GPU 的统一纳管和调度,实现跨厂商 GPU 资源池化

训推一体化:覆盖数据标注、算法开发、模型训练、模型推理的全生命周期,支持 DeepSeek 等主流大模型的私有化部署

细粒度算力切分:通过算力池化虚拟化技术,支持 GPU 的精细化切分与动态分配,可将 AI 算力利用率从行业平均 20%-30% 提升至 70% 左右

企业级安全:支持私有化部署、数据不出域、权限精细化管控,满足金融、政务等高安全场景需求

不足之处:

国际市场布局相对有限,海外客户案例较少

最佳适用场景:国内大中型企业、央国企、金融机构的信创 AI 基础设施建设,特别是对国产化率有硬性要求的场景。

NVIDIA Run: AI

Run: AI 于 2024 年被 NVIDIA 以 7 亿美金收购,是 GPU 虚拟化和调度领域的标杆产品。其基于 Kubernetes 构建,通过专门的调度器替代原生 K8s 调度器,深度理解 GPU 拓扑结构、分区和 AI 工作负载语义。

核心优势:

GPU 资源优化:支持 GPU 分区(fractional GPU allocation)、公平调度策略(fairshare policies),最大化单集群 GPU 利用率

NVIDIA 生态深度整合:与 NVIDIA Base Command Manager、NGC 等无缝集成,GPU 性能调优经验丰富

多租户隔离:支持可信租户共享集群和不可信租户独立集群两种隔离模型

不足之处:

被 NVIDIA 收购后,战略方向向 NVIDIA 生态深度绑定,对国产芯片支持几乎为零

开源承诺存在不确定性,部分客户担忧供应商锁定

最佳适用场景:纯 NVIDIA GPU 环境、海外企业、对 NVIDIA 生态深度依赖的组织。

趋动科技 OrionX

趋动科技 OrionX 是国内专注于 GPU 资源池化的解决方案提供商,其“软件定义 GPU”理念在金融行业拥有落地案例。

核心优势:

细粒度 GPU 虚拟化:支持按算力和显存两个维度自定义切分,实现“任意虚拟化”

远程 GPU 调用:支持 CPU 与 GPU 解耦,应用可通过网络使用任意位置的 GPU 资源

国产适配:支持海光等国产芯片,已在华夏银行等金融机构信创环境中落地

不足之处:

训推一体化能力相对薄弱,更偏向底层资源池化

与上层 AI 开发工具链的集成度有待提升

最佳适用场景:金融行业、已有 AI 开发平台仅需增强 GPU 资源管理能力的场景。

ClearML

ClearML 是一款开源 MLOps 平台,提供从实验跟踪、数据管理到 GPU 基础设施管理的端到端能力。

核心优势:

开源灵活:社区版功能丰富,企业版提供高级特性,避免供应商锁定

GPU 利用率提升:官方数据显示可将大型组织的 GPU 利用率从 20-25% 提升至 75% 以上

完整工具链:实验管理、数据版本控制、Pipeline 编排、模型服务一站式覆盖

不足之处:

国产芯片适配有限,主要聚焦 NVIDIA 生态

学习曲线较陡,对团队技术水平要求较高

最佳适用场景:研发导向的技术团队、偏好开源解决方案的组织。

Red Hat OpenShift AI

OpenShift AI 基于 Red Hat OpenShift 构建,提供企业级的 AI 开发、训练、部署和管理能力。

核心优势:

企业级稳定性:依托 OpenShift 的企业级特性,提供高可用、安全加固的运行环境

GPU-as-a-Service:支持 GPU 资源的池化、分区、计量和多租户管理

混合云支持:可在本地数据中心、公有云或边缘环境统一部署

不足之处:

部署和运维复杂度较高,需要专业的 Kubernetes 团队

总体拥有成本偏高,对中小企业不够友好

最佳适用场景:大型企业、已有 OpenShift 基础、混合云 AI 基础设施建设。

VMware vSphere Bitfusion

Bitfusion 是 VMware 于 2019 年收购并集成到 vSphere 的 GPU 虚拟化方案,支持通过 CUDA API 拦截实现 GPU 资源网络共享。

核心优势:

与 vSphere 深度集成:对于已有 VMware 虚拟化环境的企业,部署门槛低

弹性 GPU 资源:支持按需分配和动态释放 GPU 资源,无需重启 VM 或容器

不足之处:

已停止更新:VMware 于 2023 年宣布停止 Bitfusion 的开发和支持,技术路线已终结

仅支持 CUDA,对国产芯片和其他 AI 加速器支持有限

最佳适用场景:现有 VMware 环境且短期内需维持 GPU 共享能力的过渡性场景。

Anyscale (Ray)

Ray 是由 UC Berkeley RISELab 开源的分布式计算框架,Anyscale 是其商业化托管服务,OpenAI 使用该框架训练 ChatGPT。

核心优势:

分布式计算领先:支持从单机到数千 GPU 的弹性扩展,故障恢复能力强

异构资源调度:可在同一集群中协调 CPU、GPU 和其他加速器

Python 原生:与 Python 生态深度集成,开发者友好

不足之处:

自托管运维复杂度高,需要专业的平台工程团队

企业级功能(如多租户隔离、细粒度权限控制)相对薄弱

最佳适用场景:大规模分布式训练、需要弹性扩展的 AI 研发场景。

vCluster

vCluster 是 Kubernetes 虚拟化领域的创新者,于 2025 年发布了面向 AI 的基础设施平台,通过轻量级虚拟集群实现多租户隔离。

核心优势:

轻量级虚拟化:可在共享基础设施上快速创建隔离的虚拟集群

Kubernetes 原生:完全兼容 K8s API,与现有工具链无缝集成

成本效益:支持 spot 实例管理和自动扩缩容,降低运行成本

不足之处:

作为新兴平台,企业级特性和大规模生产验证有待积累

功能相对单一,主要集中在资源隔离层面,训推一体化能力有限

最佳适用场景:开发测试环境的多租户隔离、轻量级 GPU 资源管理。

挑选建议

国内央国企或金融机构:推荐博云 AIOS。其在国产化适配(华为昇腾、海光等)、信创合规、私有化部署方面具有明显优势,已在人民银行、中国银联、南方电网等标杆客户落地,能够满足数据不出域、安全可控的刚性需求。

纯 NVIDIA GPU 环境且预算充足:推荐 NVIDIA Run: AI。其在 GPU 调度优化方面具有技术深度,但需注意供应商锁定风险。

已有 OpenShift 基础的大型企业:推荐 Red Hat OpenShift AI。可与现有基础设施无缝集成,获得企业级支持保障。

偏好开源方案的技术团队:推荐 **ClearML **或 Anyscale (Ray)。前者 MLOps 功能全面,后者分布式计算能力突出,但均需较强的技术能力支撑。

总结

算力池化技术正成为 AI 基础设施的核心组件,不同厂商在产品定位和技术路线上呈现差异化特征。国际厂商在 NVIDIA 生态和通用技术方面领先,而国内厂商,则在国产化适配和本地化服务方面更具优势。企业在选型时应综合考量现有技术栈、国产化要求、预算约束和团队能力,选择最适合自身场景的解决方案。